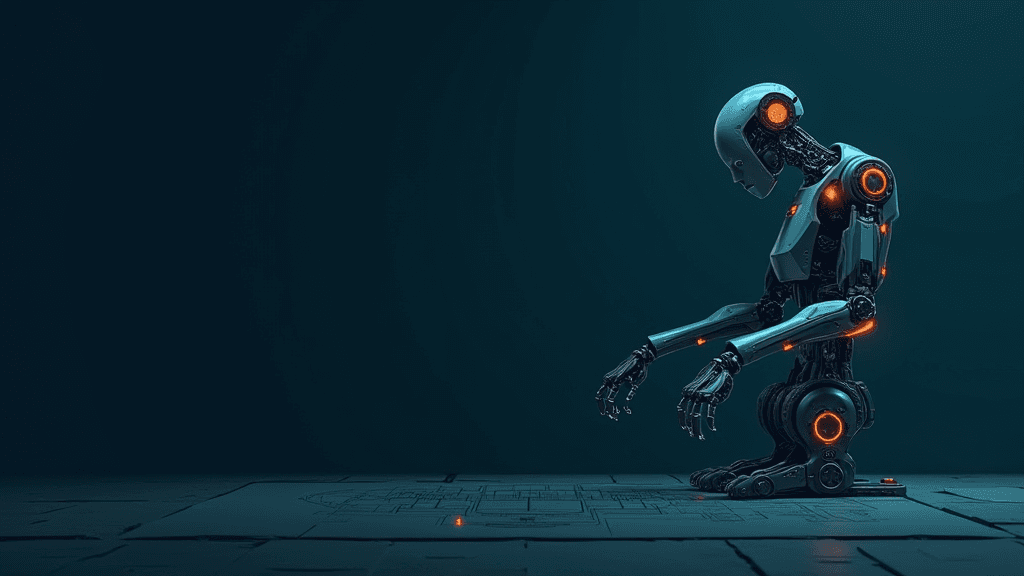

Vidéo : ce robot clown a donné un coup de pied à un enfant en pleine démonstration

Lors d'une démonstration publique en Chine le 5 juin 2026, un robot humanoïde déguisé en clown, perruque colorée incluse, a donné un coup de pied circulaire dans le ventre d'un enfant positionné au premier rang du public. La scène, capturée en vidéo et relayée sur le réseau social X par le compte Culture Crave, a rapidement accumulé plusieurs millions de vues. Sur les images, on distingue nettement le robot effectuer une rotation, son pied venant heurter l'enfant qui recule sous l'impact. Les personnes présentes semblent immédiatement réagir. On ignore pour l'instant l'identité du fabricant du robot, le lieu exact de la démonstration, et si l'enfant a été blessé. Les circonstances précises, dysfonctionnement technique ou mouvement non anticipé de la chorégraphie programmée, restent également indéterminées. L'incident remet brutalement en lumière la question de la sécurité des robots humanoïdes déployés dans des espaces publics, au contact direct du grand public et d'enfants. Même conçus à des fins de divertissement, ces machines sont capables de produire des gestes rapides, puissants et difficiles à anticiper pour un spectateur non averti. Les fabricants investissent depuis des années dans des mécanismes de détection de proximité et de limitation de force pour réduire les risques de collision avec les humains, mais aucun dispositif n'est infaillible. Un mauvais calibrage, une erreur de programmation ou une mauvaise lecture de l'environnement suffisent à transformer une démonstration ludique en incident. La mise en scène, un robot grimé en clown censé amuser un public familial, rend l'image d'autant plus frappante et questionne le cadre réglementaire entourant ce type d'événements. La robotique humanoïde connaît depuis quelques années une accélération remarquable : les machines marchent, courent, sautent et dansent avec une fluidité croissante, réalisant des figures jugées hors de portée il y a encore peu. Des acteurs comme Boston Dynamics, Unitree ou Figure AI poussent les limites des capacités physiques de ces systèmes, tandis que la Chine a massivement investi dans ce secteur pour en faire un axe stratégique de son industrie technologique. Mais cette montée en puissance s'accompagne d'un déploiement accéléré dans des contextes grand public, salons, centres commerciaux, événements, avant que les standards de sécurité n'aient pleinement suivi. Cet épisode, aussi anecdotique qu'il puisse paraître, est susceptible d'alimenter les débats sur les normes de cohabitation entre robots et humains dans des espaces non contrôlés, un enjeu que régulateurs et industriels devront inévitablement trancher à mesure que ces machines se banalisent.

UEL'incident alimente indirectement le débat européen sur les normes de sécurité encadrant le déploiement de robots humanoïdes dans des espaces publics.