Télémétrie orientée gouvernance pour le contrôle en boucle fermée des systèmes IA multi-agents

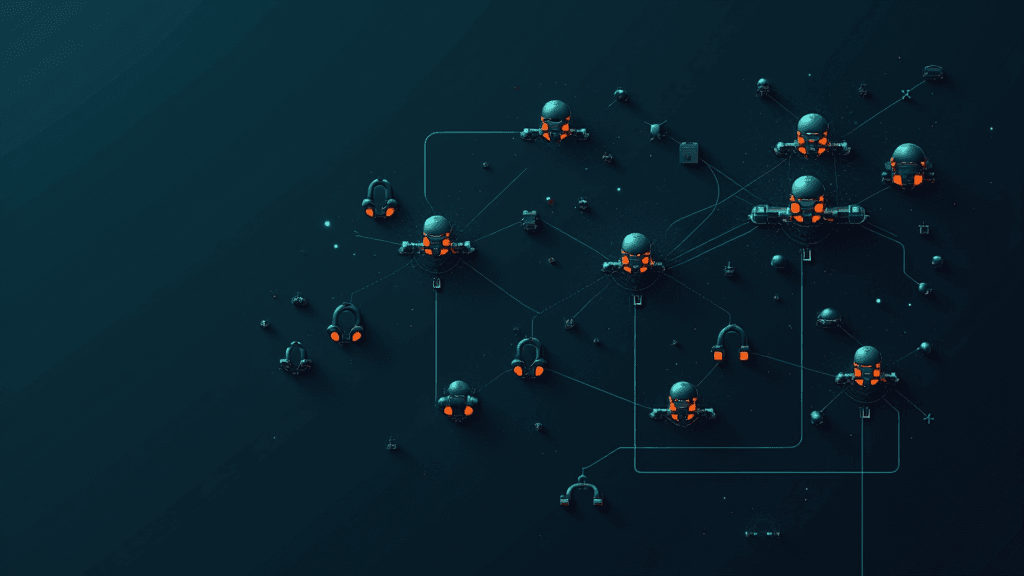

Les systèmes d'IA multi-agents déployés en entreprise génèrent des milliers d'interactions inter-agents par heure, créant un défi de supervision inédit. Des chercheurs ont présenté GAAT (Governance-Aware Agent Telemetry), une architecture de référence conçue pour fermer la boucle entre la collecte de télémétrie et l'application automatique de politiques de gouvernance dans ces environnements complexes. L'architecture cible précisément le point aveugle laissé par les outils actuels comme OpenTelemetry ou Langfuse, qui enregistrent les données d'observabilité sans jamais intervenir en temps réel.

Le problème que GAAT cherche à résoudre est concret : aujourd'hui, les violations de politiques dans les pipelines d'agents IA ne sont détectées qu'après coup, une fois les dommages causés. Ce fossé "observer-sans-agir" expose les entreprises à des risques opérationnels, réglementaires et de sécurité significatifs. En couplant la télémétrie à un moteur d'exécution de politiques, GAAT permet de détecter et bloquer une violation au moment même où elle se produit, transformant l'observabilité en levier de contrôle actif.

Cette proposition s'inscrit dans un contexte où l'adoption des architectures multi-agents s'accélère fortement, notamment avec des frameworks comme LangGraph, AutoGen ou CrewAI, sans que les outils de gouvernance n'aient suivi le même rythme. Les régulations émergentes sur l'IA, en particulier l'AI Act européen, imposent des exigences croissantes de traçabilité et d'auditabilité des systèmes automatisés. GAAT représente une tentative de combler ce retard en proposant un standard d'architecture que les équipes d'ingénierie pourraient adopter avant que les incidents ne forcent leur main.

L'AI Act européen imposant des exigences de traçabilité et d'auditabilité des systèmes automatisés, GAAT propose une architecture de référence concrète que les entreprises européennes pourraient adopter pour anticiper leur mise en conformité réglementaire.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.