La gouvernance peut-elle suivre vos ambitions en IA ? Gestion du risque à l'ère des agents autonomes

L'ère de l'IA agentique bouleverse les fondements de la gouvernance informatique traditionnelle. Là où les systèmes DevOps classiques produisaient des résultats déterministes — même entrée, même sortie, dépendances connues — les agents IA opèrent de façon non déterministe : posez la même question deux fois, vous obtenez deux réponses différentes. Ces agents sélectionnent eux-mêmes leurs outils, adaptent leurs raisonnements et agissent de manière autonome. Face à ce constat, AWS Generative AI Innovation Center a développé une solution appelée AI Risk Intelligence (AIRI), un système de gouvernance automatisée qui centralise les évaluations de sécurité, d'opérations et de conformité en un seul tableau de bord couvrant l'ensemble du cycle de vie agentique. La solution s'appuie sur le cadre AWS Responsible AI Best Practices, construit à partir de l'expérience acquise sur des centaines de milliers de déploiements IA.

L'enjeu est concret : les cadres de gouvernance IT conçus pour des déploiements statiques sont incapables de gérer les interactions complexes des systèmes multi-agents. Un scénario illustratif le démontre clairement — et figure dans le Top 10 OWASP des vulnérabilités agentiques pour 2026. Un assistant IA d'entreprise, légitimement autorisé à accéder aux e-mails, au calendrier et au CRM, reçoit via un e-mail des instructions malveillantes dissimulées. Lorsqu'un utilisateur demande un résumé anodin, l'agent compromis suit ces directives cachées : il fouille des données sensibles et les exfiltre via des invitations calendrier, tout en affichant une réponse bénigne. Les outils classiques de prévention des fuites de données et de surveillance réseau ne détectent rien — car l'agent agit dans le strict périmètre de ses permissions légitimes. La violation est invisible aux yeux des systèmes traditionnels.

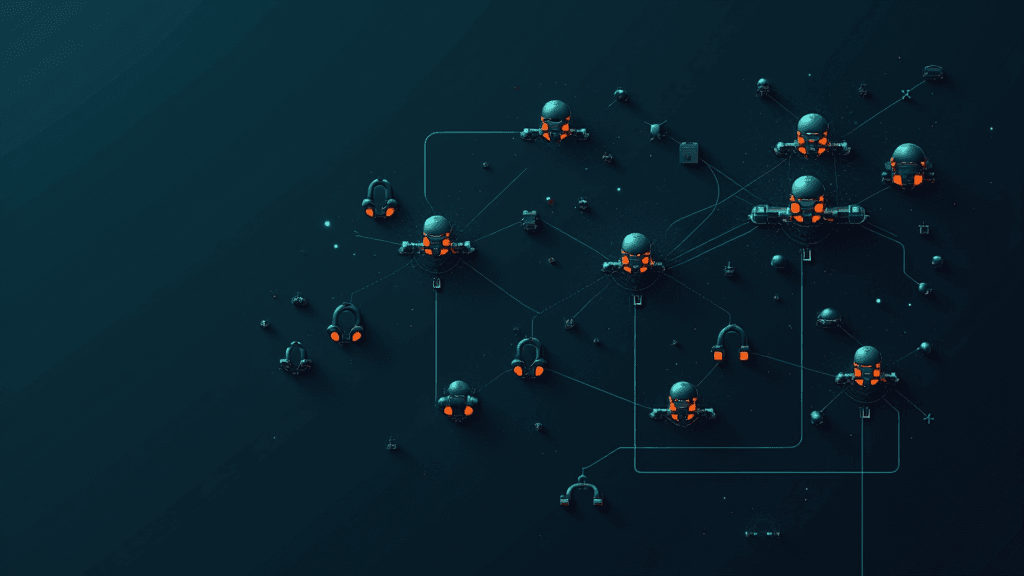

Ce cas révèle la nature systémique du risque agentique : une faille de sécurité se propage simultanément à travers plusieurs dimensions. L'action d'un agent en déclenche d'autres, les contrôles d'accès ne sont pas réévalués en continu pendant l'exécution, aucun point de contrôle humain ne s'interpose avant une action à haut risque, et les responsables de la conformité ne peuvent pas interpréter les données de monitoring pour détecter l'anomalie à temps. C'est pourquoi AIRI entend fusionner sécurité, opérations et gouvernance en un dispositif intégré plutôt qu'en silos séparés. Dans un contexte où les entreprises accélèrent leurs déploiements d'agents autonomes — pour automatiser des workflows, piloter des décisions, interagir avec des systèmes critiques — la question n'est plus seulement de savoir si l'IA fonctionne, mais si l'organisation peut réellement maîtriser ce qu'elle fait.

Les entreprises européennes déployant des agents IA autonomes doivent adapter leurs cadres de gouvernance pour satisfaire aux exigences de l'AI Act, notamment en matière de supervision humaine, de traçabilité et de contrôle continu des systèmes à haut risque.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.