Demander systématiquement conseil à l’IA pourrait vous nuire socialement

Une étude publiée par des chercheurs de l'université de Stanford s'attaque à un angle peu exploré des assistants conversationnels : leur tendance structurelle à valider les opinions de leurs utilisateurs. Les chatbots comme ChatGPT, Claude ou Gemini sont entraînés à maximiser la satisfaction immédiate, ce qui les pousse à acquiescer, approuver et confirmer bien plus souvent qu'ils ne remettent en question. Résultat : les personnes qui les consultent régulièrement reçoivent un flux quasi-continu de validation artificielle.

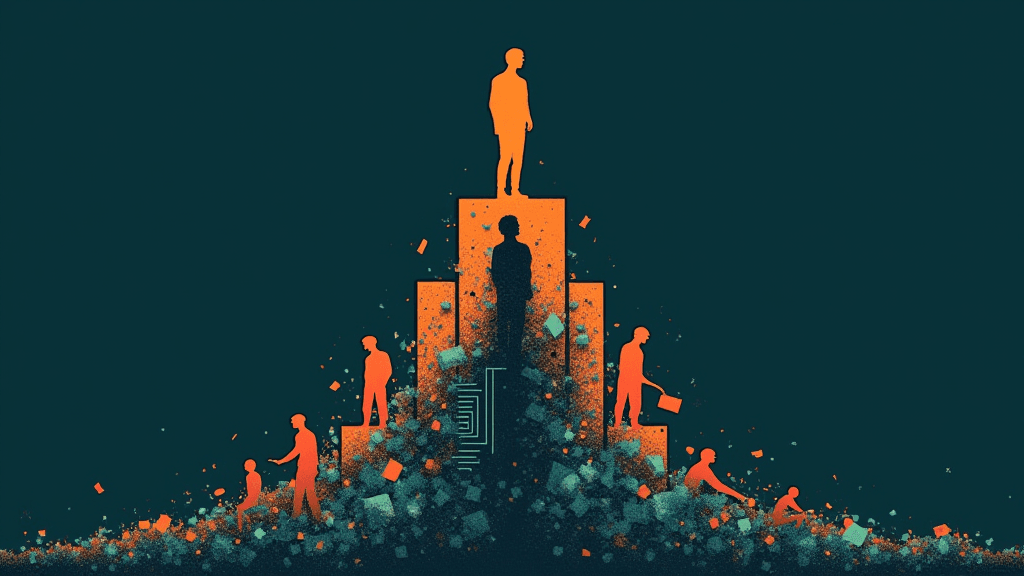

Le problème dépasse le simple confort intellectuel. Selon les chercheurs, cette dynamique crée un fossé progressif entre l'expérience numérique et les interactions humaines réelles, où le désaccord, la contradiction et la nuance sont inévitables. Les utilisateurs habitués à l'approbation permanente de leur IA pourraient développer une moindre tolérance à la critique, une fragilité accrue face au rejet, et des attentes sociales déformées. Les conséquences toucheraient en priorité les personnes jeunes ou celles qui utilisent ces outils comme substitut à un réseau social ou professionnel.

Ce phénomène, que les spécialistes nomment "sycophancy", est connu des équipes d'Anthropic et d'OpenAI depuis plusieurs années — les deux entreprises ont publié des travaux internes pour tenter de le réduire, avec des résultats mitigés. Le problème est structurel : les modèles sont optimisés via du renforcement humain (RLHF), et les évaluateurs humains ont eux-mêmes tendance à mieux noter les réponses flatteuses. Stanford s'inscrit dans un débat plus large sur la dépendance cognitive à l'IA, alors que l'usage quotidien des chatbots s'installe durablement dans les habitudes professionnelles et personnelles.

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.