MetaClaw entraîne des agents IA pendant vos réunions en consultant Google Calendar

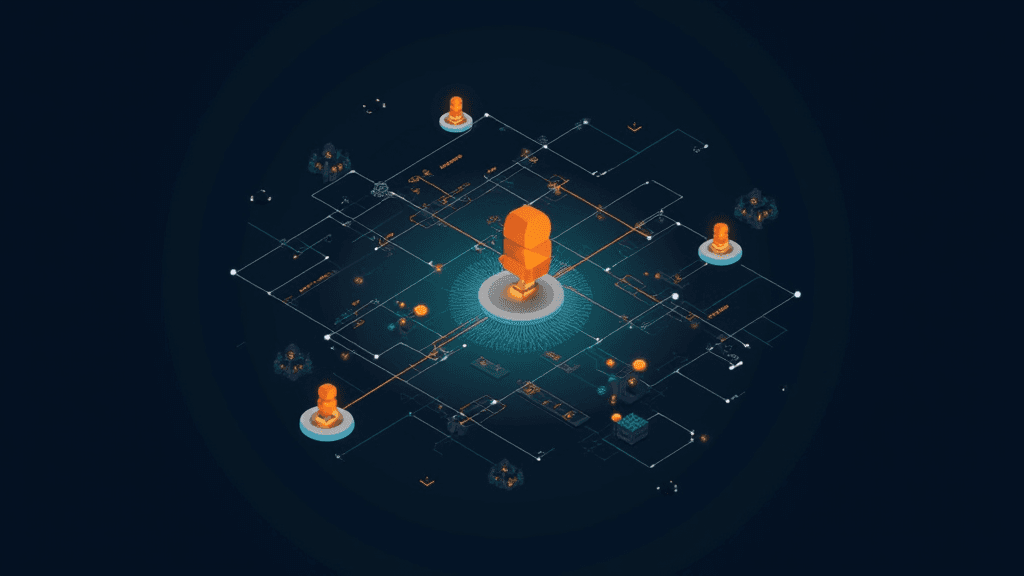

Des chercheurs issus de quatre universités américaines ont mis au point MetaClaw, un framework conçu pour entraîner des agents d'intelligence artificielle de manière continue, sans interrompre leur utilisation. La particularité du système : il consulte le calendrier Google de l'utilisateur pour identifier les créneaux d'inactivité — réunions, pauses, déplacements — et en profite pour lancer des cycles d'apprentissage en arrière-plan. L'entraînement se déroule donc pendant que l'utilisateur est occupé, sans mobiliser de ressources au moment où il sollicite l'agent.

Cette approche résout un problème fondamental des agents IA déployés en production : l'amélioration continue sans interruption de service. Jusqu'ici, mettre à jour un modèle impliquait soit de l'arrêter, soit d'accepter des dégradations temporaires de performance. MetaClaw permet d'optimiser l'agent en temps réel, en s'adaptant au rythme de travail réel de l'utilisateur. Pour les entreprises qui dépendent d'assistants IA dans leurs workflows quotidiens, cela représente un gain notable de fiabilité et d'efficacité opérationnelle.

Ce travail s'inscrit dans un courant de recherche croissant autour de l'apprentissage continu (continual learning) et des agents IA adaptatifs — deux domaines en pleine effervescence depuis la multiplication des assistants déployés en environnement professionnel. L'intégration d'un signal aussi concret que l'agenda personnel pour orchestrer l'entraînement illustre une tendance plus large : ancrer les systèmes IA dans les contraintes réelles des utilisateurs plutôt que dans des cycles de mise à jour planifiés. La publication n'a pas encore précisé de date de diffusion du code ni de calendrier de déploiement commercial.

L'idée est maline : utiliser les trous de calendrier pour entraîner l'agent en arrière-plan, sans jamais couper le service. C'est exactement le genre de contrainte qu'on contourne en prod à grands coups de maintenances nocturnes. Bon, pas de code dispo pour l'instant, donc on attend de voir si ça tient hors conditions de labo.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.