L'IA physique soulève des questions de gouvernance pour les systèmes autonomes

La convergence de l'intelligence artificielle et des systèmes physiques pose des questions de gouvernance inédites pour les entreprises, les régulateurs et les ingénieurs. En 2024, la Fédération internationale de la robotique recensait 542 000 robots industriels installés dans le monde, soit plus du double du niveau enregistré dix ans plus tôt. Les projections tablent sur 575 000 unités en 2025 et plus de 700 000 d'ici 2028. Dans ce contexte, le marché de ce que les analystes appellent désormais la "Physical AI" -- robotique, edge computing et machines autonomes -- était estimé à 81,64 milliards de dollars en 2025 par Grand View Research, avec des projections atteignant 960,38 milliards en 2033. En mars 2025, Google DeepMind a franchi une étape concrète en lançant Gemini Robotics et Gemini Robotics-ER, deux modèles construits sur Gemini 2.0 et conçus pour le contrôle direct de robots et le raisonnement spatial. En avril 2026, une nouvelle version, Gemini Robotics-ER 1.6, a été mise en préversion via l'API Gemini, avec des capacités renforcées de planification de tâches, de détection de succès et de raisonnement par étapes intermédiaires.

L'enjeu dépasse largement celui de l'automatisation logicielle classique. Lorsqu'un modèle de langage produit une réponse incorrecte, l'erreur reste dans le domaine informationnel. Lorsqu'un modèle piloté un robot, une sortie erronée peut se traduire par un mouvement physique dans un environnement partagé avec des humains ou connecté à des équipements industriels critiques. Google DeepMind identifie trois propriétés fondamentales pour des robots véritablement utiles : la généralité (capacité à traiter des objets et environnements inconnus), l'interactivité (adaptation aux instructions humaines et aux conditions changeantes), et la dextérité (précision des gestes physiques). Des systèmes comme Gemini Robotics peuvent suivre des instructions en langage naturel et exécuter des séquences complexes -- plier du papier, emballer des objets, manipuler des éléments jamais vus à l'entraînement. Mais cette même flexibilité complique la définition de limites de sécurité claires et de procédures d'arrêt d'urgence.

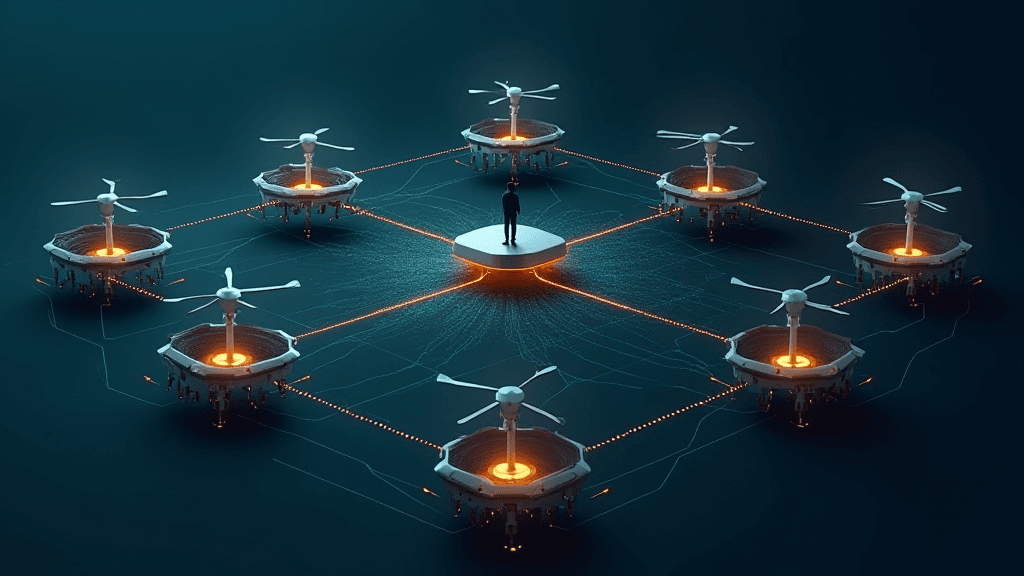

Derrière la performance technique se profile un problème de gouvernance systémique encore non résolu. Contrairement aux logiciels, les systèmes physiques autonomes opèrent dans des espaces réels, soumis à des normes de sécurité industrielles, de responsabilité civile et de certification qui n'ont pas été conçues pour des agents capables de raisonner et de décider de façon autonome. La mise à disposition de Gemini Robotics-ER 1.6 via l'API Gemini rapproche le développement de ces systèmes des environnements de tests accessibles aux développeurs, mais transfère aussi une partie de la responsabilité vers les intégrateurs. Le secteur se retrouve face à une question centrale : qui valide, surveille et peut arrêter un agent physique lorsque son comportement s'écarte des limites prévues ? Les réponses réglementaires et industrielles à cette question seront déterminantes pour le déploiement à grande échelle de la Physical AI dans les prochaines années.

Les industriels et régulateurs européens devront réviser les cadres de responsabilité civile, de certification et de sécurité des machines pour couvrir des agents physiques autonomes capables de raisonner, un vide que l'AI Act actuel n'adresse pas encore directement.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.