MolmoAct : implémentation pour le raisonnement spatial 3D, le suivi de trajectoire et la prédiction robotique

Des chercheurs d'AllenAI ont publié MolmoAct, un modèle multimodal de 7 milliards de paramètres conçu pour raisonner dans l'espace tridimensionnel à partir d'observations visuelles. Le modèle, identifié sous la référence allenai/MolmoAct-7B-D-0812, accepte des entrées multi-vues, c'est-à-dire plusieurs images prises sous différents angles, et génère à partir d'instructions en langage naturel trois types de sorties : une estimation de profondeur, une trajectoire visuelle tracée, et des commandes d'action directement exploitables par un système robotique. Un tutoriel d'implémentation complet a été publié pour permettre aux développeurs de reproduire l'ensemble du pipeline dans Google Colab, en s'appuyant sur PyTorch 2.0 ou supérieur, la bibliothèque Transformers en version 4.52, et une infrastructure GPU standard.

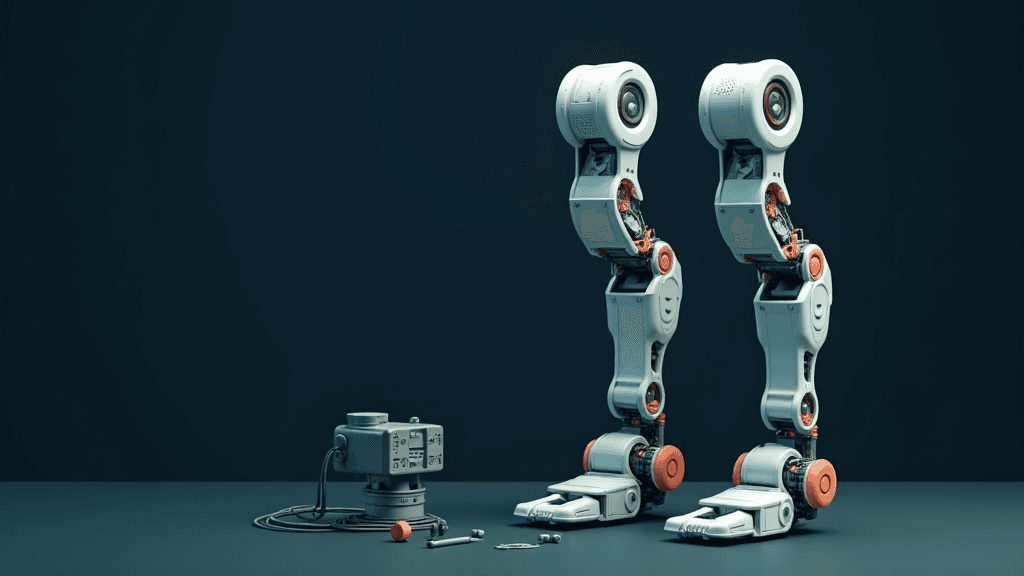

Ce type de modèle représente un changement de paradigme dans la robotique pilotée par l'IA : plutôt que de séparer la perception visuelle, la compréhension spatiale et la planification motrice dans des modules distincts, MolmoAct intègre ces trois capacités dans un seul réseau neuronal interrogeable en langage humain. Concrètement, un opérateur peut demander au modèle d'atteindre un objet dans une scène complexe, et le système produit directement la séquence d'actions requise, en tenant compte des distances et obstacles perçus dans les images. Pour les équipes travaillant sur des bras robotiques, des drones autonomes ou des systèmes d'assistance, cette architecture réduit considérablement la complexité d'intégration et ouvre la voie à des robots pilotables par des non-spécialistes.

MolmoAct s'inscrit dans une vague de modèles dits "action-reasoning" qui cherchent à combler le fossé entre vision par ordinateur et contrôle robotique. AllenAI, l'institut de recherche fondé par Paul Allen et affilié à l'Université de Washington, développe depuis plusieurs années la famille de modèles Molmo, positionnée comme une alternative ouverte aux modèles multimodaux propriétaires de Google ou OpenAI. La publication d'un tutoriel d'implémentation pas-à-pas, avec un code entièrement reproductible et accessible sur des GPUs grand public, traduit une volonté délibérée de démocratiser ces capacités. La prochaine étape naturelle sera l'évaluation de MolmoAct sur des benchmarks robotiques standardisés et son intégration dans des environnements physiques réels, où la robustesse face aux variations d'éclairage et d'occlusion restera le principal défi.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.