Anthropic a-t-il mesuré les capacités théoriques de l'IA sur le marché du travail ?

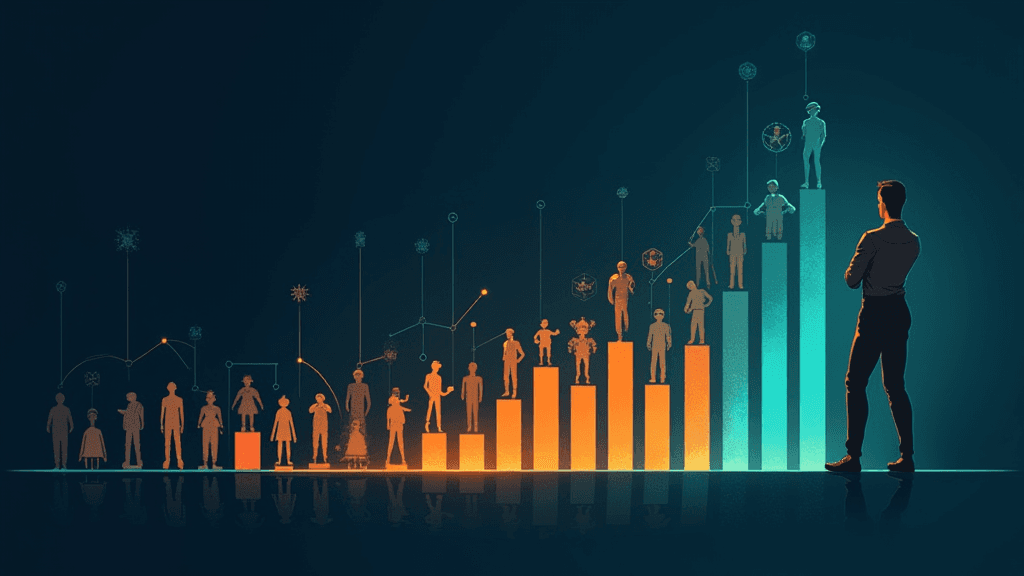

Anthropic a publié ce mois-ci un rapport sur l'impact de l'intelligence artificielle sur le marché du travail, accompagné d'un graphique qui a rapidement circulé dans les milieux spécialisés. Ce visuel compare, sur 22 catégories professionnelles, l'« exposition observée » actuelle des métiers aux grands modèles de langage (en rouge) à leur « capacité théorique » (en bleu). Au premier regard, la zone bleue est saisissante : elle suggère que les systèmes basés sur des LLM pourraient, en théorie, accomplir au moins 80 % des tâches individuelles dans des secteurs aussi variés que les arts et médias, l'administration, le droit, la finance et même le management.

L'interprétation de ce graphique a toutefois été largement exagérée. En creusant la méthodologie, la zone bleue ne représente pas une prédiction de remplacement massif des travailleurs par des machines, mais des estimations spéculatives — et en partie obsolètes — sur les domaines où l'IA pourrait améliorer la productivité humaine. Autrement dit, « capacité théorique » ne signifie pas « capacité de remplacer » : il s'agit de tâches que les LLM pourraient potentiellement assister ou automatiser en partie, sans que cela implique la disparition des postes correspondants.

Ce rapport s'inscrit dans un débat plus large sur la quantification réelle de l'impact économique de l'IA générative. Anthropic, comme d'autres acteurs du secteur, cherche à cadrer la discussion publique autour de l'adoption de ses modèles — ce qui crée un intérêt institutionnel évident à présenter des chiffres d'exposition élevés. Les économistes du travail soulignent depuis longtemps la différence entre automatisation de tâches et suppression d'emplois entiers. La viralité du graphique illustre combien une visualisation mal calibrée peut alimenter des craintes — ou des enthousiasmes — déconnectés de la réalité méthodologique sous-jacente.

Les biais méthodologiques dans la quantification de l'exposition des emplois aux LLM concernent directement les décideurs politiques français et européens qui s'appuient sur ces rapports pour calibrer leurs politiques d'emploi et de reconversion professionnelle.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.