Construire un système de détection des éruptions solaires sur SageMaker AI avec des réseaux LSTM et les données ESA STIX

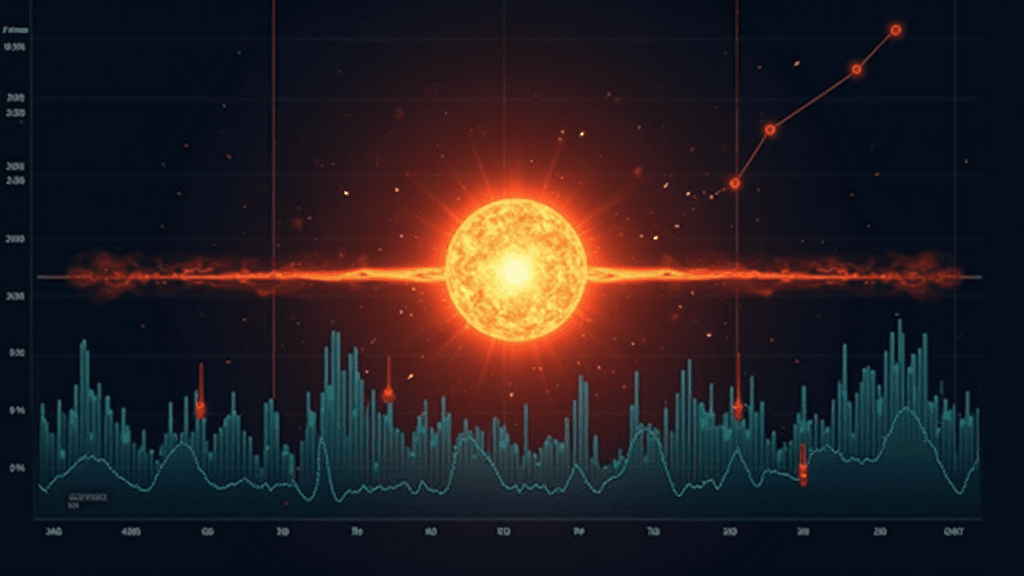

Amazon Web Services propose une solution de détection automatique des éruptions solaires en combinant les réseaux de neurones LSTM (Long Short-Term Memory) et les données du spectromètre STIX de l'Agence spatiale européenne (ESA), le tout déployé sur la plateforme SageMaker AI. Le système analyse les émissions de rayons X solaires sur trois bandes d'énergie distinctes : basse (4–10 keV), moyenne (10–25 keV) et haute (25+ keV). Concrètement, l'architecture repose sur deux algorithmes complémentaires : le Random Cut Forest (RCF), un algorithme d'apprentissage non supervisé qui attribue des scores d'anomalie selon la densité des points de données, et le réseau LSTM, capable de mémoriser des dépendances temporelles sur de longues séquences — une propriété rare dans les réseaux de neurones classiques. L'instrument STIX, embarqué sur la sonde Solar Orbiter lancée par l'ESA, collecte en continu des volumes massifs de mesures X que ce pipeline est conçu à ingérer et analyser à grande échelle.

L'enjeu est considérable : les éruptions solaires perturbent les communications radio, dégradent les orbites satellitaires et peuvent mettre en danger les astronautes. Une détection précoce et fiable conditionne directement la protection des infrastructures spatiales et des réseaux électriques terrestres. L'approche multi-canal apporte ici une valeur ajoutée concrète — les canaux basse énergie captent les phénomènes précurseurs, tandis que les canaux haute énergie trahissent les pics d'intensité les plus violents. Grâce aux propriétés de mémoire à long terme du LSTM, le modèle peut identifier des schémas d'évolution sur des périodes étendues, là où des méthodes statistiques classiques échoueraient. Pour les opérateurs de satellites commerciaux et les agences spatiales, cela se traduit par une fenêtre d'alerte élargie pour mettre en mode sécurisé les équipements sensibles.

Cette publication s'inscrit dans une tendance plus large : l'application du machine learning à la physique solaire connaît une accélération marquée depuis que le volume de données issues des observatoires spatiaux dépasse les capacités d'analyse humaine. L'ESA et la NASA multiplient les missions dédiées à la météorologie spatiale — Solar Orbiter, Parker Solar Probe — générant des flux de mesures sans précédent. AWS, de son côté, cherche à positionner SageMaker comme la plateforme de référence pour les applications scientifiques à fort volume de données, en proposant des exemples concrets dans des domaines aussi variés que la climatologie ou l'astrophysique. La prochaine étape logique serait l'intégration de ce système dans des pipelines d'alerte opérationnels en temps réel, potentiellement couplés aux centres de prévision météorologique spatiale comme le Space Weather Prediction Center de la NOAA.

L'ESA est directement impliquée via l'instrument STIX de Solar Orbiter, et les opérateurs de satellites européens pourraient exploiter ce type de pipeline pour protéger leurs infrastructures face aux éruptions solaires.

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.