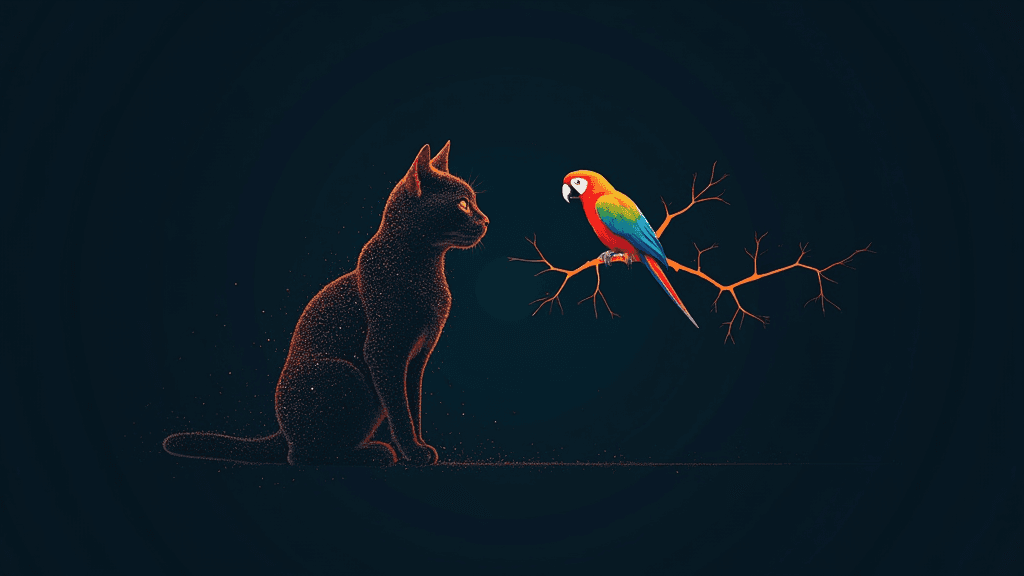

OPINION. « Quand le chat avalera le perroquet »

Les grands modèles de langage actuels, souvent comparés à des perroquets stochastiques capables de reproduire du texte sans le comprendre, pourraient bientôt être supplantés par une nouvelle génération d'intelligences artificielles. Cette tribune d'opinion, publiée dans la rubrique Homo Numericus, avance que la prochaine rupture technologique ne portera pas sur la maîtrise du langage — déjà largement acquise — mais sur la capacité des IA à modéliser le monde physique et causal, à en comprendre les mécanismes profonds plutôt que d'en imiter la surface.

L'enjeu est considérable : une IA capable de construire des représentations internes du monde réel, et non plus seulement de ses descriptions textuelles, ouvrirait la voie à des systèmes autonomes fiables dans des domaines critiques — robotique, sciences, médecine, ingénierie. Ce saut qualitatif marquerait le passage d'un outil de génération à un véritable agent de raisonnement.

Cette perspective s'inscrit dans un débat de fond qui traverse la recherche en IA depuis des années : les architectures transformer actuelles ont-elles les capacités structurelles pour atteindre une compréhension causale du monde, ou faut-il des paradigmes radicalement nouveaux ? Des chercheurs comme Yann LeCun défendent depuis longtemps cette limite fondamentale des LLMs, et l'article semble s'inscrire dans ce courant critique qui anticipe un changement de paradigme majeur.

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.