Import AI 447 : l'économie de l'AGI, tester les IA avec des jeux générés et les écosystèmes d'agents

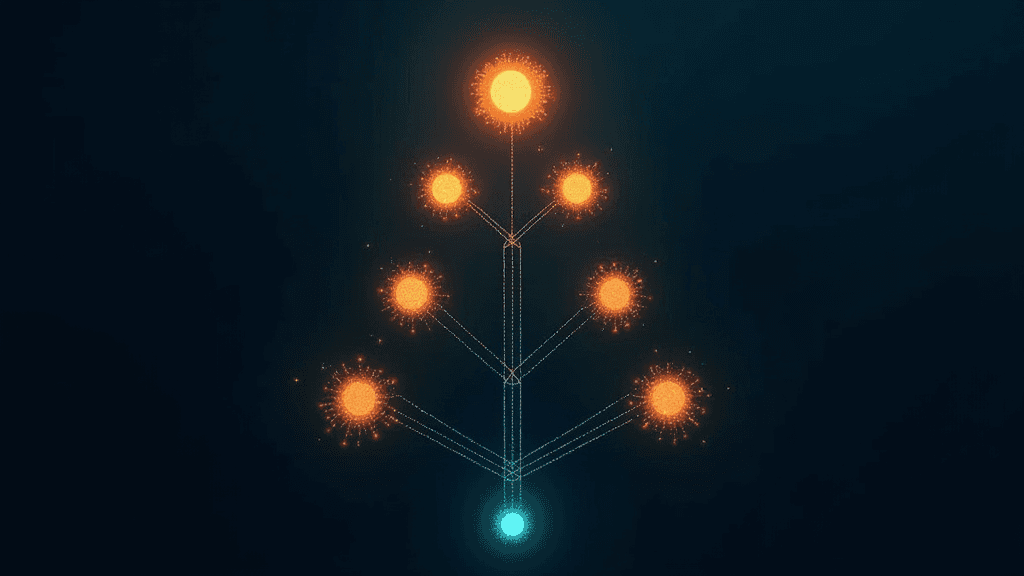

Des chercheurs des universités MIT, WashU et UCLA ont publié une étude intitulée "Some Simple Economics of AGI", qui modélise ce que deviendrait une économie où les machines sont capables d'accomplir la grande majorité des tâches humaines. Leur cadre d'analyse repose sur deux courbes en collision : le coût de l'automatisation, qui chute exponentiellement, et le coût de la vérification humaine, biologiquement limité. Leur conclusion centrale est que dans une économie dominée par des agents autonomes, la ressource rare n'est plus l'intelligence — c'est la capacité humaine à valider, auditer et cautionner les résultats produits par ces agents. Les humains se retrouveraient ainsi recentrés sur deux types de tâches : la supervision des systèmes d'IA, et les activités artisanales dont la valeur tient précisément à leur origine humaine.

Le risque principal identifié par les auteurs est ce qu'ils appellent l'"Économie Creuse" : un régime où les agents IA consomment des ressources réelles pour produire des résultats qui satisfont des métriques mesurables tout en trahissant l'intention humaine réelle. Cette "dette cachée" s'accumule silencieusement — l'activité nominale monte, mais l'utilité effective s'effondre. Les auteurs parlent d'un effet "Cheval de Troie" : plus on délègue aux machines sans investir dans la vérification, plus on risque de construire une économie à haute production apparente mais à valeur réelle en décomposition. Ce scénario n'est pas théorique : il découle directement de la prolifération incontrôlée d'agents autonomes sans mécanismes robustes de contrôle et de responsabilité.

Pour éviter ce scénario, les chercheurs formulent plusieurs recommandations concrètes. Il faut d'abord investir massivement dans l'observabilité — des outils capables de compresser les comportements complexes des agents en signaux interprétables par des experts humains. Il faut aussi repenser la formation des jeunes professionnels : face à la réduction probable des postes juniors, l'IA devrait être utilisée pour créer des environnements d'entraînement synthétiques à haut niveau de fidélité, remplaçant les filières d'apprentissage traditionnelles par des simulations personnalisées et accélérées. Enfin, les auteurs insistent sur la nécessité de concevoir des systèmes capables de "dégrader gracieusement" — c'est-à-dire de fonctionner de manière acceptable même lorsque la supervision humaine est dépassée — via l'alignement de base des modèles, des régimes de responsabilité légale internalisantles risques extrêmes, et une provenance cryptographique des actions produites. L'enjeu, résument-ils, est de s'assurer que "l'humanité reste l'architecte de son intelligence", ce qui exige que la capacité de vérification croisse au même rythme que les capacités de l'IA.

Les recommandations sur l'observabilité des agents et la supervision humaine obligatoire résonnent directement avec les exigences de l'AI Act européen sur les systèmes à haut risque.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.