IA et fracture économique : l'avertissement de Larry Fink (BlackRock)

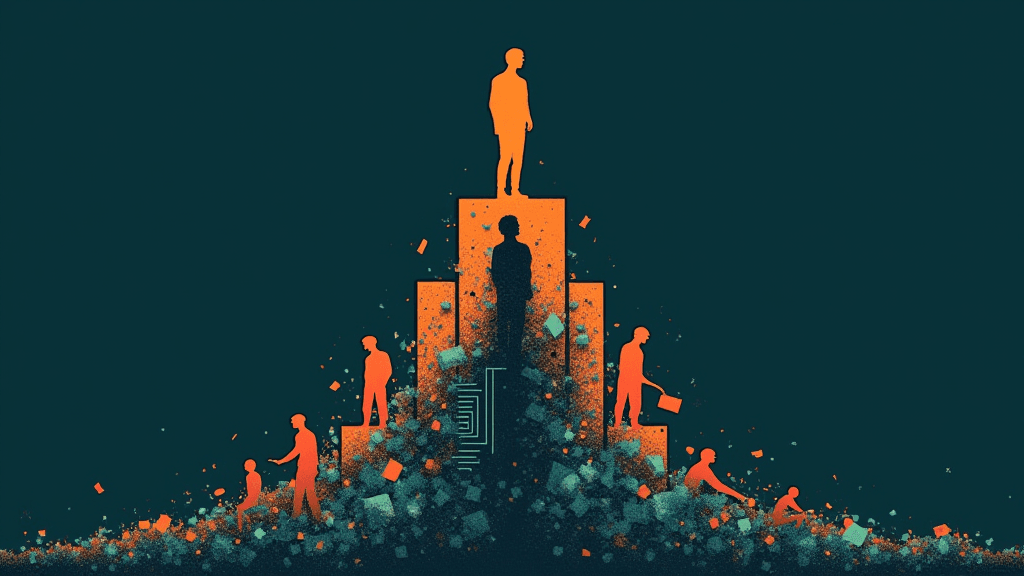

Larry Fink, PDG de BlackRock, le plus grand gestionnaire d'actifs au monde avec plus de 10 000 milliards de $ sous gestion, lance un avertissement sévère : l'intelligence artificielle pourrait devenir le moteur d'une fracture économique sans précédent si ses bénéfices restent concentrés entre les mains des seuls détenteurs de capital.

Le constat est structurel. Contrairement aux révolutions industrielles précédentes qui ont, à terme, redistribué de la valeur via l'emploi et les salaires, l'IA automatise des tâches cognitives à grande échelle — menaçant directement les classes moyennes et les travailleurs qualifiés. Si les gains de productivité générés par l'IA ne bénéficient qu'aux actionnaires, l'écart de richesse entre propriétaires d'actifs et salariés risque de s'accélérer de façon structurelle et durable.

Fink plaide pour une démocratisation de l'accès à l'investissement comme réponse systémique : permettre à davantage de citoyens de devenir propriétaires d'actifs financiers — actions, infrastructures, immobilier — afin de participer aux rendements générés par l'IA. Il s'agit moins d'une critique de la technologie que d'un appel à repenser les mécanismes de distribution de la valeur économique à l'ère de l'automatisation intelligente.

La prise de position de BlackRock sur ce sujet n'est pas anodine : en tant que premier actionnaire institutionnel de nombreuses entreprises tech développant l'IA, le groupe a une influence directe sur les politiques de redistribution et de gouvernance de ces acteurs. Ce signal envoyé par Fink pourrait peser dans les débats politiques et réglementaires autour de la fiscalité du capital et de l'accès aux marchés financiers.

Les débats sur la taxation des grandes entreprises technologiques et la régulation de l'automatisation évoqués par Fink rejoignent les discussions en cours au sein de l'UE sur la fiscalité du numérique et l'adaptation des politiques sociales à la transition IA.

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.