Mozilla lance cq : le projet qui veut permettre aux IA de partager leurs connaissances entre elles

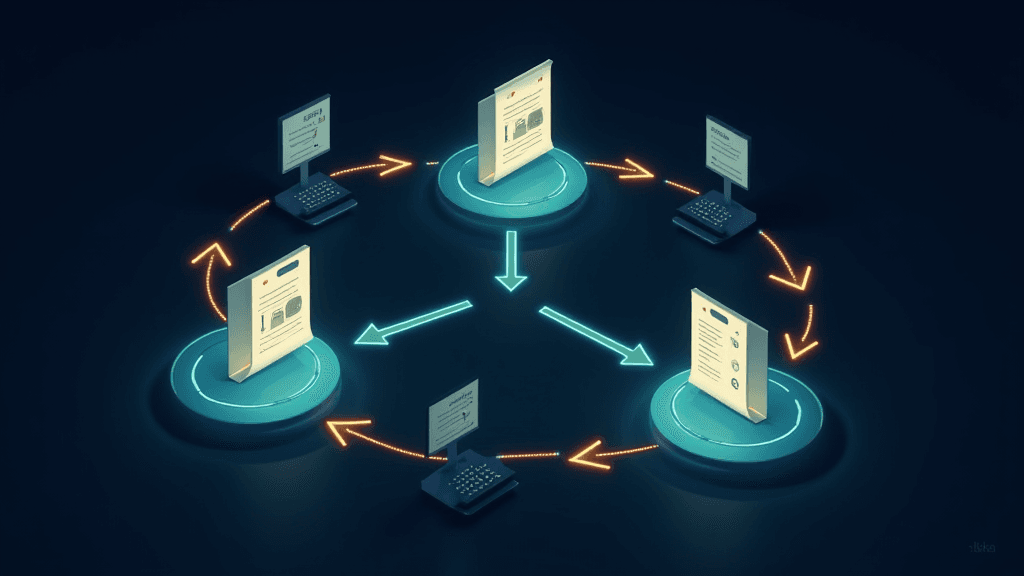

Mozilla franchit un nouveau cap dans l'écosystème de l'intelligence artificielle avec le lancement de cq, un projet open source conçu pour permettre aux agents IA de partager leurs connaissances entre eux. L'initiative, portée par un ingénieur de la fondation, part d'un constat simple mais frappant : chaque jour, des milliers d'agents IA résolvent les mêmes problèmes de façon isolée, sans capitaliser sur les apprentissages des uns et des autres.

L'enjeu est considérable pour l'industrie. À mesure que les agents autonomes prolifèrent dans les workflows professionnels et les outils grand public, leur incapacité à mutualiser leurs connaissances représente un gaspillage massif de ressources computationnelles et humaines. cq ambitionne de combler ce vide en créant une infrastructure commune où les solutions découvertes par un agent peuvent être réutilisées par d'autres, indépendamment de leur origine ou de leur architecture.

Le projet se positionne explicitement comme un successeur de Stack Overflow, la plateforme de partage de connaissances techniques qui, après avoir structuré la collaboration entre développeurs humains pendant quinze ans, connaît un déclin marqué depuis l'essor des LLMs. Là où Stack Overflow servait d'interface entre humains, cq vise à construire l'équivalent pour les machines — une base de connaissances interrogeable et enrichie en continu par les agents eux-mêmes.

La nature open source du projet laisse entrevoir une adoption communautaire potentiellement large, à condition que les acteurs majeurs du secteur — éditeurs d'agents, plateformes d'IA, entreprises tech — acceptent de jouer le jeu de l'interopérabilité. Le défi n'est pas seulement technique : il est aussi de gouvernance, car partager les connaissances entre agents implique de s'accorder sur des standards communs que l'industrie peine encore à définir.

Les développeurs européens pourraient bénéficier de cet outil open source pour réduire les redondances dans leurs pipelines d'agents IA.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.