Avancées récentes en architectures LLM : partage KV, mHC et attention compressée

Depuis début avril 2026, une vague de nouveaux modèles de langage open-weight a déferlé, et une tendance architecturale se dégage clairement : l'efficacité sur les contextes longs. Google a ouvert le bal avec sa suite Gemma 4, déclinée en quatre variantes, les modèles compacts E2B et E4B pour appareils embarqués, un modèle mixte d'experts (MoE) à 26 milliards de paramètres, et un modèle dense à 31 milliards. Dans la foulée, ZAYA1-8B, Laguna XS.2 et DeepSeek V4 ont chacun introduit leurs propres innovations internes. Ce que ces modèles ont en commun, c'est un ensemble de techniques nouvelles pour réduire la taille du KV-cache, le trafic mémoire et le coût du mécanisme d'attention, trois goulots d'étranglement devenus critiques à mesure que les modèles de raisonnement et les agents IA manipulent des séquences de plus en plus longues.

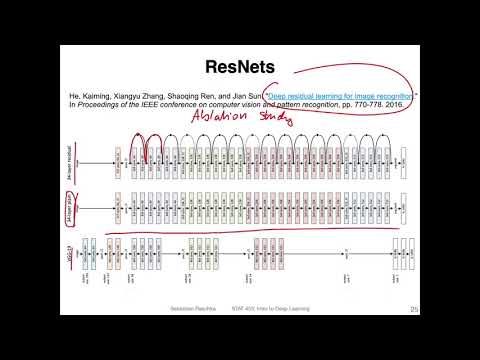

Ces innovations architecturales ont des conséquences concrètes sur les coûts d'inférence et les capacités des systèmes déployés en production. Le partage de KV entre couches (cross-layer attention), utilisé dans Gemma 4 E2B et E4B, permet aux couches profondes de réutiliser les états clé-valeur calculés dans les couches précédentes, réduisant ainsi la mémoire nécessaire sur de longs contextes sans entraîner de pertes de qualité majeures. Laguna XS.2 adopte une approche différente, en allouant un budget d'attention variable selon les couches, certaines couches traitent l'intégralité du contexte, d'autres utilisent une fenêtre glissante restreinte. ZAYA1-8B intègre une attention convolutionnelle compressée, tandis que DeepSeek V4 combine une attention multi-head compressée (mHC) avec sa propre variante d'attention compacte. Ces techniques sont présentées comme des ajustements discrets dans les schémas d'architecture, mais représentent en réalité des choix de conception non triviaux avec des implications profondes sur la façon dont les modèles gèrent la mémoire à grande échelle.

Ces développements s'inscrivent dans une évolution plus large du domaine : les workflows agentiques et les modèles de raisonnement, qui maintiennent des contextes de plusieurs dizaines de milliers de tokens sur de longues interactions, ont rendu les approches d'attention standard trop coûteuses à opérer efficacement. Le KV-cache, qui stocke les états intermédiaires pour éviter de recalculer l'attention à chaque nouveau token, peut consommer plusieurs gigaoctets de VRAM sur de longs contextes, un problème particulièrement aigu pour les déploiements locaux. Le fait que Google, DeepSeek et des acteurs plus modestes comme ZAYA1 et Laguna convergent tous vers des solutions similaires en quelques semaines suggère que l'optimisation de l'attention est devenue la priorité architecturale centrale de 2026, supplantant la simple course aux paramètres.

Les modèles open-weight à architecture optimisée (Gemma 4, DeepSeek V4) permettent aux entreprises et institutions européennes de déployer des LLMs efficacement en local, réduisant leur dépendance aux infrastructures cloud américaines.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.