Cerebras : une IPO à 60 milliards de dollars, lente puis soudaine

Cerebras Systems a fait son entrée en bourse cette semaine avec une valorisation spectaculaire de 60 milliards de dollars, clôturant à 280 dollars par action. L'introduction s'est concrétisée après un premier dossier S-1 retiré, puis un partenariat à 750 mégawatts et un accord estimé entre 10 et 20 milliards de dollars avec OpenAI. Lors des communications accompagnant l'IPO, le directeur financier Bob Komin a tenu à corriger la perception d'un positionnement limité aux petits modèles : Cerebras sert aujourd'hui des architectures de toutes tailles, y compris des modèles à un billion de paramètres, et traite en production des modèles internes d'OpenAI, notamment les versions 5.4 et 5.5. L'investisseur Ishan N. Taneja, qui avouait avoir douté des premières annonces de l'entreprise, a publiquement concédé que ses sceptiques avaient eu raison dès le départ, saluant la persévérance de l'équipe et la qualité du silicium développé.

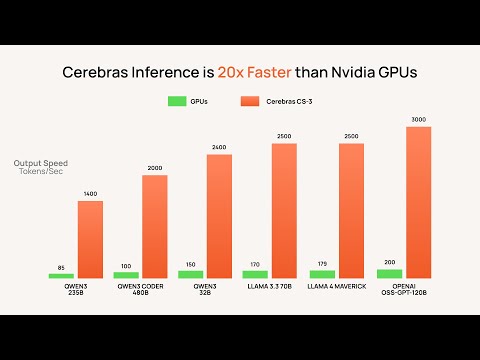

Cette introduction en bourse constitue une validation majeure pour le marché des puces d'inférence spécialisées, longtemps perçu comme trop risqué face à la domination de Nvidia. Le fait que Cerebras traite des charges de calcul aussi critiques que les modèles internes d'OpenAI confirme que son architecture, fondée sur une puce unique de la taille d'une tranche entière de wafer, est désormais compétitive sur les workloads les plus exigeants. Le chercheur Apoorv Vyas relie explicitement l'IPO à une discussion de Stanford sur la rareté du calcul, la demande d'inférence en hausse et le routage de modèles, soulignant que l'événement est interprété dans les cercles techniques comme un signal structurant pour l'ensemble du cycle d'infrastructure IA, et non comme un simple fait de marché.

Ce succès survient dans un contexte de recomposition rapide du secteur du matériel pour l'IA. Six mois plus tôt, Nvidia avait racheté Groq pour 20 milliards de dollars, un autre spécialiste de l'inférence rapide, consolidant sa position tout en signalant que ce segment attire désormais des capitaux massifs. Cerebras avait opté pour une architecture radicalement différente des GPU de Nvidia ou AMD : une puce monolithique de très grande taille, conçue spécifiquement pour les modèles de langage, plutôt que des GPU généralistes adaptés a posteriori. Ce pari industriel, considéré pendant des années comme excentrique, trouve aujourd'hui une validation boursière qui devrait encourager de nouveaux investissements dans des architectures alternatives. La suite probable est une intensification de la concurrence sur l'inférence à grande échelle et une pression croissante sur Nvidia pour défendre ses marges dans ce segment en pleine expansion.

L'essor des architectures de puces spécialisées pour l'inférence IA pourrait, à terme, diversifier les options d'approvisionnement matériel pour les acteurs et institutions européens du secteur.

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.