Amazon Bedrock Knowledge Bases : créer et déployer une solution de synchronisation automatique

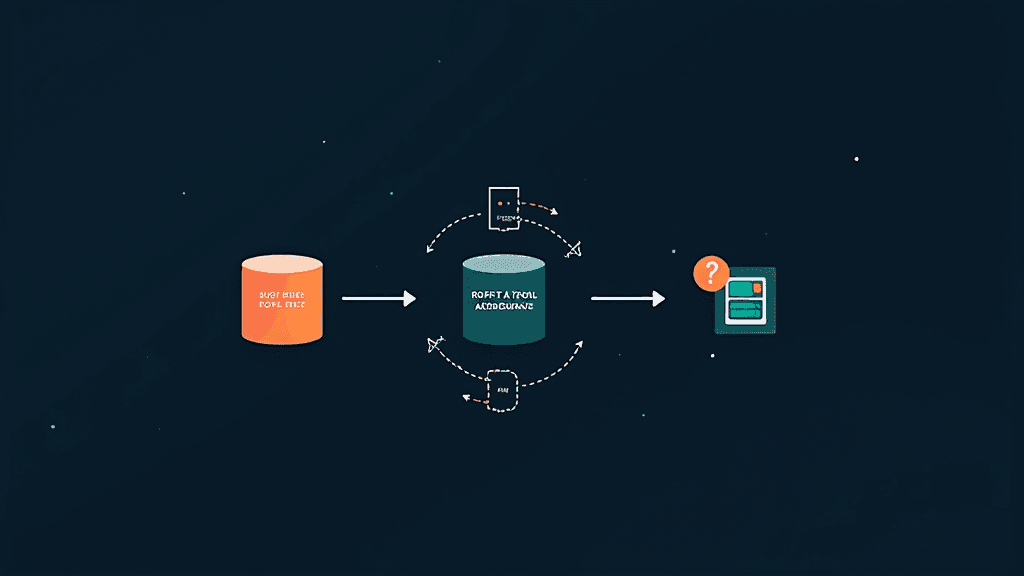

Amazon Web Services a publié la description d'une solution serverless permettant de synchroniser automatiquement les bases de connaissances Amazon Bedrock avec les documents stockés dans Amazon S3, sans aucune intervention manuelle. Conçue selon une architecture événementielle, elle repose sur cinq services AWS articulés ensemble : EventBridge capte les modifications dans les buckets S3 en temps réel, des fonctions Lambda traitent ces événements, des files SQS absorbent les pics de requêtes, Step Functions orchestre le flux de synchronisation, et DynamoDB assure le suivi des changements et des métadonnées de jobs. Le tout se déploie via AWS SAM (Serverless Application Model), sans infrastructure à provisionner ni à maintenir. Deloitte figure parmi les entreprises ayant adopté ce type d'approche pour moderniser leur infrastructure de tests et de traitement documentaire.

L'enjeu est considérable pour les organisations qui utilisent Bedrock Knowledge Bases dans des environnements multi-utilisateurs ou des applications critiques comme les systèmes de support client. Amazon Bedrock impose des quotas stricts : au maximum cinq jobs d'ingestion simultanés par compte AWS, un seul job par base de connaissances et un seul par source de données. L'API StartIngestionJob est en outre limitée à 0,1 requête par seconde, soit une requête toutes les dix secondes et par région. Sans orchestration, lorsqu'une équipe contenu met à jour plusieurs fichiers lors d'une release, les requêtes s'accumulent, percutent ces plafonds et finissent par nécessiter une supervision manuelle. La solution absorbe ces rafales en mettant les demandes en file d'attente via SQS et en les émettant au rythme autorisé par l'API, de façon totalement transparente.

Amazon Bedrock Knowledge Bases est le service RAG (Retrieval-Augmented Generation) d'AWS qui permet aux modèles de fondation et aux agents IA d'accéder aux données privées d'une organisation afin de produire des réponses plus précises et contextualisées. Jusqu'ici, toute modification dans S3, ajout, suppression ou mise à jour de métadonnées, exigeait une synchronisation déclenchée manuellement, processus sujet aux oublis et aux retards. Ce manque de synchronisation en temps réel constitue l'un des principaux points de friction dans le déploiement d'agents IA en production. La solution proposée élimine ce point de friction pour les équipes travaillant en continu sur des bases documentaires volumineuses, et représente une avancée concrète vers des systèmes d'IA d'entreprise capables de rester à jour sans supervision humaine permanente.

Dans nos dossiers