Traçabilité de bout en bout avec DVC et Amazon SageMaker AI MLflow

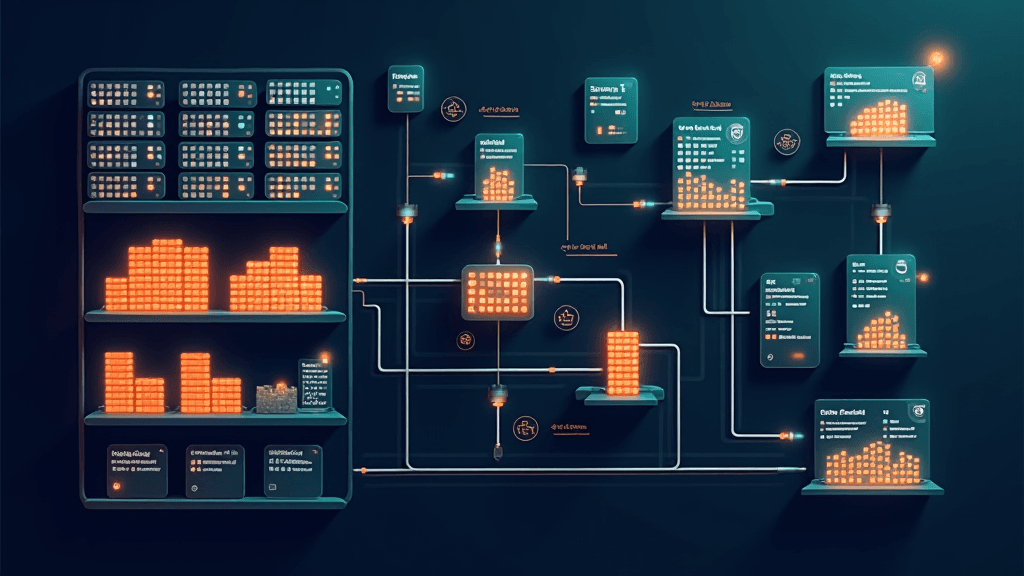

Les équipes de machine learning en production font face à un problème récurrent : retracer précisément l'origine d'un modèle déployé. Quelle version du jeu de données l'a entraîné ? Peut-on reproduire à l'identique un modèle mis en production il y a six mois ? Amazon Web Services propose une réponse concrète en combinant trois outils : DVC (Data Version Control), Amazon SageMaker AI et SageMaker AI MLflow Apps. L'architecture s'articule en quatre étapes : un job SageMaker Processing prétraite les données brutes et les versionne via DVC en les poussant vers Amazon S3 ; un job SageMaker Training clone le dépôt DVC à un tag Git précis, récupère le dataset exact via dvc pull, entraîne le modèle et enregistre tout dans MLflow. Chaque run MLflow stocke un identifiant datagitcommit_id, soit le hash DVC pointant vers le dataset exact dans S3. Le modèle entraîné est ensuite enregistré dans le MLflow Model Registry et peut être déployé sur un endpoint SageMaker. La chaîne de traçabilité complète devient alors : modèle en production → run MLflow → commit DVC → dataset dans Amazon S3.

Cet enchaînement répond à un besoin critique dans les secteurs régulés : santé, services financiers, véhicules autonomes. Dans ces domaines, les exigences d'audit imposent de relier chaque modèle déployé à ses données d'entraînement précises, et de pouvoir exclure à la demande des enregistrements individuels des futurs cycles d'entraînement. Sans ce niveau de traçabilité, une question apparemment simple, "quelles données ont servi à entraîner le modèle actuellement en production ?", peut mobiliser plusieurs jours d'enquête dans des logs dispersés, des notebooks et des buckets S3. La solution proposée réduit ce risque opérationnel en rendant la traçabilité structurelle plutôt qu'optionnelle.

DVC est un outil open source gratuit qui étend Git pour gérer des datasets volumineux et des artefacts ML que Git seul ne peut pas versionner. MLflow, de son côté, assure le suivi des expériences, le registre des modèles et la lignée. Les deux outils couvrent chacun la moitié du problème de traçabilité, et leur combinaison ferme la boucle. L'implémentation requiert un compte AWS avec des permissions sur SageMaker, S3, CodeCommit et IAM, Python 3.11 ou 3.12, et le SDK SageMaker v3.4.0 minimum. Les notebooks utilisent AWS CodeCommit comme backend Git pour les métadonnées DVC, mais l'architecture est compatible avec GitHub, GitLab ou Bitbucket moyennant un simple remplacement de l'URL remote. AWS publie des notebooks d'accompagnement permettant de déployer les deux patterns décrits, traçabilité au niveau du dataset et traçabilité au niveau de l'enregistrement individuel, directement dans un compte AWS existant.

La traçabilité structurelle décrite répond directement aux exigences de documentation et d'auditabilité imposées par l'AI Act européen pour les systèmes d'IA à haut risque dans les secteurs régulés (santé, finance, véhicules autonomes).

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.