Ghost Murmur : l’IA secrète de la CIA qui entend votre coeur à 65 km

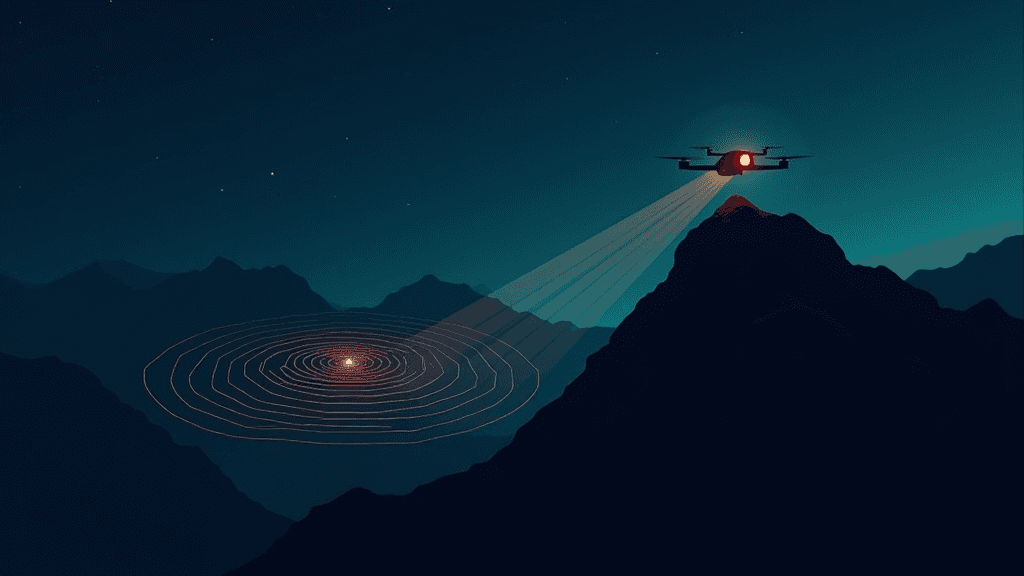

La CIA aurait utilisé pour la première fois sur le terrain un système de détection biométrique à longue portée baptisé Ghost Murmur lors d'une opération de sauvetage en Iran en avril 2026. Un pilote américain abattu au-dessus du territoire iranien a survécu deux jours dans une zone montagneuse désertique, caché dans une crevasse, sans que les moyens de recherche classiques ne parviennent à le localiser précisément. Sa balise de survie standard ne suffisait pas. C'est alors que Ghost Murmur est entré en action : ce dispositif couplant intelligence artificielle et magnétométrie quantique aurait réussi à détecter la signature électromagnétique émise par son cœur, à une distance annoncée de plusieurs dizaines de kilomètres. Le système, développé par la division Skunk Works de Lockheed Martin, la même unité secrète à l'origine du SR-71 Blackbird et du U-2, analyse les signaux électromagnétiques faibles liés à l'activité cardiaque, filtre le bruit ambiant grâce à des algorithmes poussés, et isole une signature biologique distincte. L'extraction s'est finalement déroulée sans perte humaine côté américain.

L'enjeu opérationnel est considérable : Ghost Murmur représente une rupture technologique dans la localisation humaine à distance, en particulier dans des environnements où les moyens conventionnels échouent. Pour les forces spéciales et les agences de renseignement, la capacité de détecter un signe de vie sans contact visuel, sans émetteur actif, et dans un terrain hostile, change fondamentalement les calculs de sauvetage au combat. Le désert iranien s'est révélé un environnement favorable au système : peu d'interférences électromagnétiques, fort contraste thermique nocturne entre un corps vivant et le sol froid, faible densité de signaux parasites. Les analystes ont croisé les données pour confirmer la position avant de lancer l'extraction, ce qui suggère un processus de validation multi-source plutôt qu'une détection automatique immédiate.

Ghost Murmur s'inscrit dans une tendance plus large de militarisation de la biométrie et des capteurs quantiques, un domaine dans lequel les États-Unis investissent massivement depuis plusieurs années pour maintenir leur supériorité dans les opérations spéciales. La magnétométrie quantique, qui repose sur des matériaux ultra-sensibles capables de mesurer des champs magnétiques infimes, était jusqu'ici principalement étudiée en laboratoire ou dans des contextes médicaux. Son déploiement terrain ouvre des perspectives qui dépassent le seul sauvetage de pilotes : surveillance de périmètre, détection d'infiltration, voire ciblage. Des tests sur des plateformes aériennes militaires seraient déjà en cours. Mais la technologie reste en phase d'expérimentation avancée, et ses limites, notamment le temps d'analyse des algorithmes et la nécessité de zones peu saturées en signaux, encadrent encore son champ d'application réel.

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.