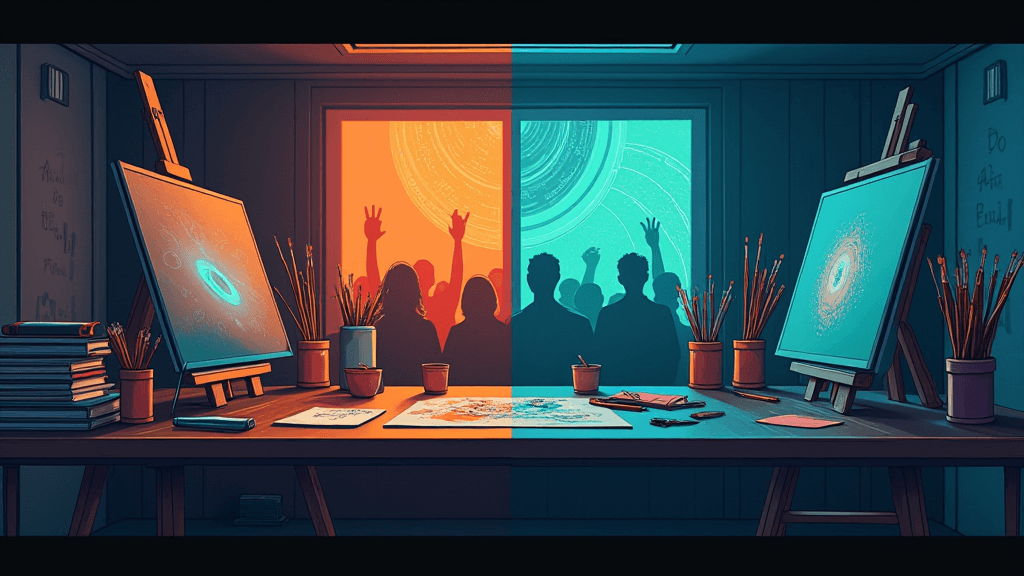

Collaborer avec 400 000 enseignants pour façonner l'avenir de l'IA dans les écoles

OpenAI collabore avec l'American Federation of Teachers pour lancer une initiative de 5 ans visant à former 400,000 enseignants des écoles primaires et secondaires à diriger l'innovation en intelligence artificielle dans les salles de classe.

L'initiative d'OpenAI avec l'American Federation of Teachers vise à former 400,000 enseignants américains en IA, potentiellement influençant l'enseignement des compétences en IA dans les écoles américaines, sans impact direct immédiat pour les entreprises françaises ou européennes, mais pouvant inspirer des mouvements similaires dans l'UE, alignés avec le RGPD et l'AI Act, pour préparer les enseignants aux nouvelles exigences de l'éducation numérique.

Dans nos dossiers

Vu une erreur factuelle dans cet article ? Signalez-la. Toutes les corrections valides sont publiées sur /corrections.