Meta publie TRIBE v2 : un modèle de codage cérébral qui prédit les réponses IRM fonctionnelle aux stimuli vidéo, audio et texte

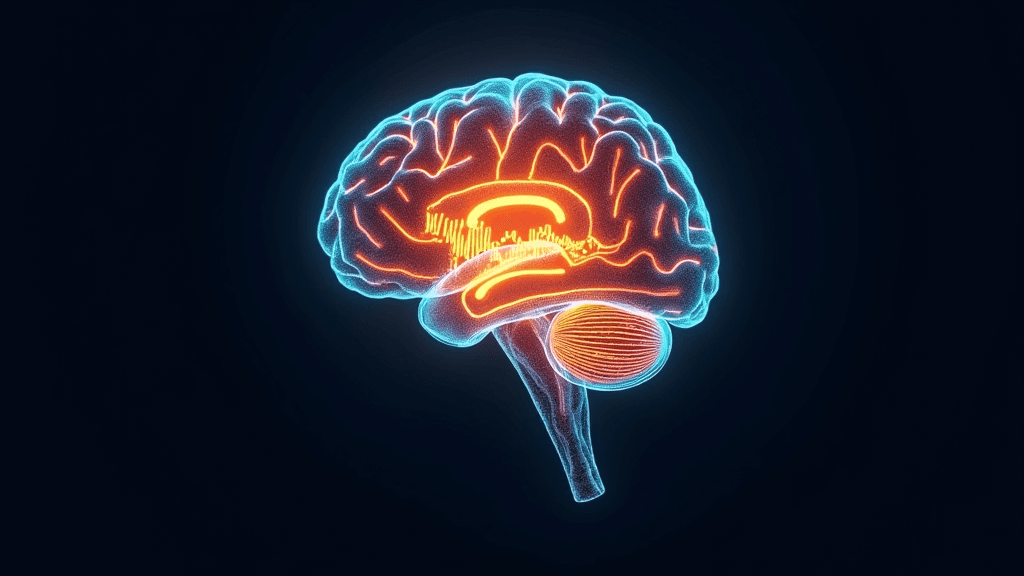

L'équipe FAIR de Meta a publié TRIBE v2, un modèle fondationnel trimodal capable de prédire les réponses cérébrales mesurées par IRM fonctionnelle (fMRI) à partir de stimuli vidéo, audio et textuels combinés. Le modèle repose sur trois encodeurs spécialisés — LLaMA 3.2-3B pour le texte, V-JEPA2-Giant pour la vidéo, et Wav2Vec-BERT 2.0 pour l'audio — dont les représentations sont fusionnées dans un Transformer à 8 couches analysant des fenêtres temporelles de 100 secondes. Le résultat est ensuite projeté sur 20 484 vertices corticaux et 8 802 voxels sous-corticaux pour produire une carte haute résolution de l'activité cérébrale. L'entraînement a mobilisé 451,6 heures de données fMRI issues de 25 sujets, et l'évaluation a porté sur 1 117,7 heures couvrant 720 sujets supplémentaires.

TRIBE v2 surpasse significativement les modèles FIR (Finite Impulse Response), qui constituaient jusqu'ici l'étalon-or en encodage cérébral voxel par voxel. Sa capacité la plus frappante est la généralisation zéro-shot : sans avoir jamais vu un sujet, le modèle prédit la réponse moyenne d'un nouveau groupe avec une précision supérieure à celle de nombreux enregistrements individuels au sein de ce même groupe. Sur le jeu de données Human Connectome Project 7T à haute résolution, il atteint une corrélation de groupe proche de 0,4 — soit le double de la médiane des sujets. Avec seulement une heure de données d'un nouveau sujet, le modèle peut en outre être affiné pour des prédictions individualisées. Les chercheurs observent une progression log-linéaire de la précision avec le volume de données d'entraînement, sans plateau visible.

La neuroscience cognitive a longtemps fonctionné par fragmentation : chaque région cérébrale étudiée séparément, chaque modalité sensorielle modélisée indépendamment. TRIBE v2 s'inscrit dans une tendance inverse, celle des modèles fondationnels multimodaux capables de capturer la manière dont le cerveau intègre simultanément sons, images et langage dans des conditions naturelles — des films, des podcasts, des vidéos silencieuses. Cette approche ouvre la voie à une neuroscience computationnelle plus écologique, capable d'étudier le cerveau tel qu'il fonctionne vraiment, et non dans des paradigmes expérimentaux artificiels. À mesure que les bases de données de neuroimagerie s'agrandiront, la puissance prédictive de tels modèles devrait continuer à croître, avec des applications potentielles en psychiatrie computationnelle, en interfaces cerveau-machine, et dans la compréhension des mécanismes cognitifs sous-jacents à la perception multimodale.