Bluesky lance une application IA pour personnaliser votre fil d'actualité

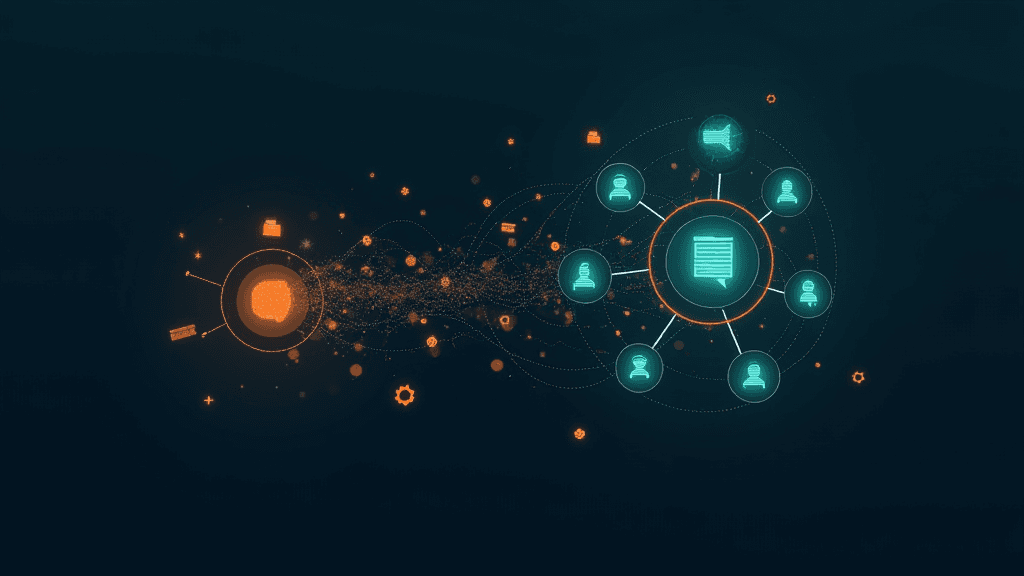

Bluesky a dévoilé Attie lors de la conférence Atmosphere, un assistant IA qui permet aux utilisateurs de construire leurs propres algorithmes de fil d'actualité en langage naturel. L'application a été présentée par l'ancienne PDG de Bluesky, Jay Graber, et le directeur technique Paul Frazee. Attie s'appuie sur Claude, le modèle d'Anthropic, et est construit sur l'AT Protocol (atproto), le protocole ouvert qui sous-tend l'ensemble de l'écosystème Bluesky. Concrètement, un utilisateur peut demander à Attie de lui composer un fil centré sur « le folklore, la mythologie et la musique traditionnelle, notamment les traditions celtiques » — et l'IA génère l'algorithme correspondant.

Pour l'instant, ces fils personnalisés sont limités à une application autonome Attie, mais l'équipe prévoit de les intégrer directement dans Bluesky et dans toutes les applications compatibles atproto. Ce changement donne aux utilisateurs un contrôle éditorial réel sur ce qu'ils voient, sans dépendre des choix opaques d'un algorithme centralisé imposé par la plateforme — une rupture directe avec le modèle de TikTok ou de X.

Cette annonce s'inscrit dans la montée en puissance de Bluesky comme alternative décentralisée aux grands réseaux sociaux, portée par la vague de départs de X depuis le rachat par Elon Musk. L'AT Protocol, conçu pour être ouvert et interopérable, devient ici un terrain d'expérimentation pour une nouvelle génération d'outils IA communautaires. Si Attie se déploie largement, il pourrait redéfinir la relation entre utilisateurs et algorithmes de recommandation à l'échelle d'un réseau social entier.

Bluesky étant très populaire en France suite aux migrations massives depuis X, Attie offre aux utilisateurs français un contrôle éditorial concret sur leur fil d'actualité sans dépendre d'algorithmes opaques imposés par la plateforme.