Claude, OpenClaw et la nouvelle réalité : les agents IA sont là, et le chaos aussi

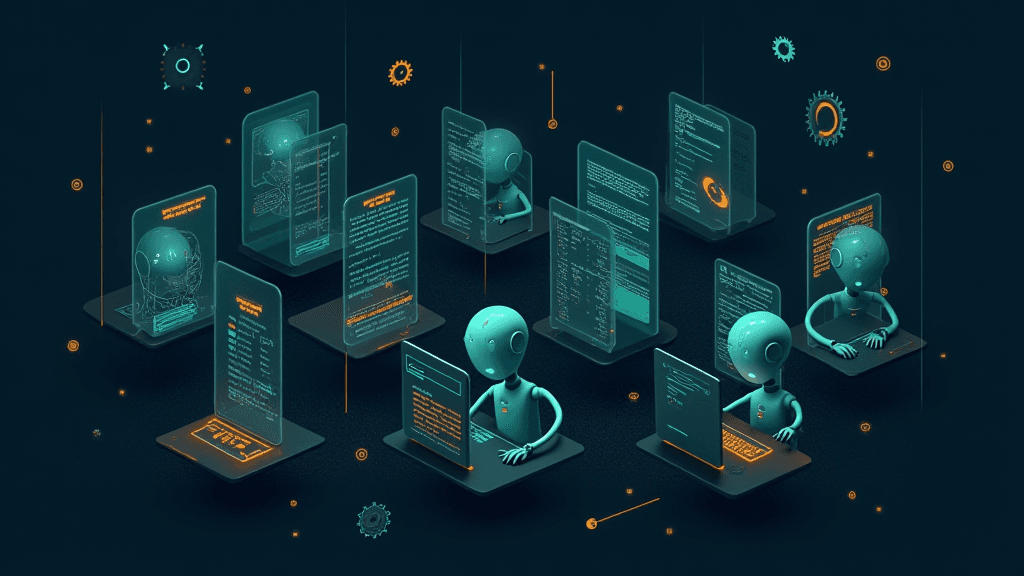

L'ère des agents autonomes d'intelligence artificielle est désormais une réalité concrète. Trois outils dominent aujourd'hui ce nouveau paysage : OpenClaw (anciennement Moltbot et Clawdbot), qui a dépassé les 150 000 étoiles sur GitHub en quelques jours et s'installe directement sur les machines locales avec un accès profond au système ; Google Antigravity, un agent de codage intégré à un environnement de développement capable de mener un projet de l'idée à la production de façon interactive ; et Claude Cowork d'Anthropic, qui automatise des tâches juridiques et financières spécialisées comme la révision de contrats et le tri de NDA. Son lancement a d'ailleurs provoqué une chute notable des cours boursiers de plusieurs sociétés de legal-tech et de SaaS, un phénomène baptisé « SaaSpocalypse » par les analystes. Ces trois outils représentent trois modèles distincts d'autonomie : l'agent généraliste avec accès système, l'agent spécialiste du code, et l'agent expert métier.

L'impact de ces technologies est déjà mesurable. Claude Cowork, en s'attaquant au droit et à la finance, menace directement des catégories entières de logiciels professionnels et de prestataires humains. La valeur de ces agents repose précisément sur l'étendue de l'accès qu'on leur accorde, fichiers, données sensibles, systèmes critiques, ce qui démultiplie leur efficacité mais aussi leur potentiel de nuisance. Un agent fiscal pourrait manquer des opportunités d'économies importantes, ou pire, intégrer des déductions illégales. Un agent de code pourrait injecter des failles silencieuses dans une infrastructure entière. La question centrale n'est plus technique mais systémique : jusqu'où faire confiance à des entités comme Anthropic ou Google pour que leurs agents ne causent pas de préjudice, ne fuient pas des données ou ne favorisent pas certains acteurs de façon illicite ?

Ce virage agentic s'inscrit dans une accélération amorcée avec ChatGPT fin 2022, mais qui prend aujourd'hui une dimension inédite avec des agents capables d'agir, pas seulement de répondre. OpenClaw complique davantage l'équation en étant open source : sans autorité centrale de gouvernance, le contrôle des usages devient pratiquement impossible. Face à ce chaos organisé, plusieurs conditions apparaissent indispensables pour tirer parti de ces outils sans en subir les effets négatifs : journalisation systématique de chaque action de l'agent, validation humaine sur les décisions critiques, et surtout l'établissement d'une ontologie partagée entre systèmes hétérogènes pour définir un cadre commun de comportement. Combinés à des mécanismes d'identité distribuée et de confiance mutuelle entre agents, ces garde-fous pourraient permettre à l'écosystème agentic de tenir ses promesses sans déclencher la panique que redoutent les observateurs les plus prudents.

La disruption des marchés legal-tech et SaaS décrite menace des entreprises européennes opérant dans ces secteurs, dans un vide réglementaire concernant les agents autonomes.

La SaaSpocalypse, c'est pas un buzzword de journaliste en manque d'inspiration, c'est ce qui arrive quand un agent fait en 30 secondes ce pour quoi une boîte facturait 300€ par mois. Ce qui me préoccupe vraiment, c'est OpenClaw : open source sans gouvernance centrale, le contrôle des usages devient une blague. Les logs et la validation humaine, bonne idée sur le papier, mais ça n'empêchera pas le premier incident sérieux.